Todos los aqu� presentes, m�s o menos, tenemos cierta idea de c�mo funcionan los gr�ficos de un juego. Sabemos lo que son los pol�gonos, las animaciones, la iluminaci�n, los reflejos� Pero �sabemos c�mo se genera un frame? �C�mo se van superponiendo diferentes efectos y procesos hasta dar forma a esas im�genes que luego vemos en movimiento? Hay multitud de art�culos t�cnicos donde encontrar informaci�n detallada al respecto, pero nuestro objetivo es hacer una versi�n sencilla y f�cil de entender para todo el mundo. Adem�s, vamos a usar como referencia uno de esos art�culos: el fant�stico an�lisis de Adrian Curr�ges del Fox Engine en Metal Gear Solid V: The Phantom Pain.

Creando la base

Lo primero que queremos dejar claro es que cada juego y, sobre todo, cada motor, genera el frame de manera diferente. En el caso del Fox Engine en Metal Gear Solid V: The Phantom Pain comienza dibujando el suelo� incluso cuando no lo vemos.

En la escena del hospital que vamos a analizar, el terreno bajo el suelo del hospital se genera antes que el propio hospital, para, seguidamente, hacer lo propio con los personajes y dem�s elementos del escenario. Si os pregunt�is por qu� el suelo tiene prioridad, la raz�n es que, seguramente, en los escenarios abiertos, es muy �til para el juego saber qu� se esconde tras colinas y monta�as para seleccionar qu� mostrar y qu� no, ayudando a optimizar el rendimiento.

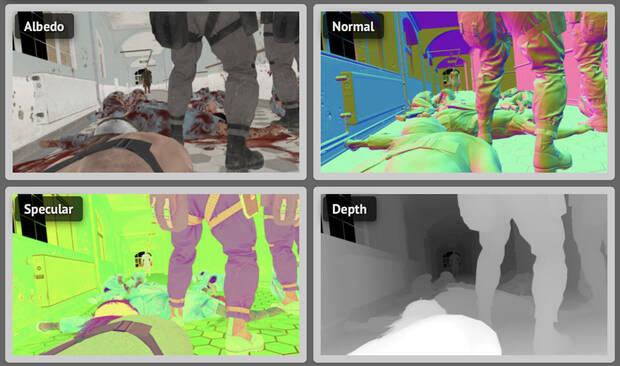

El siguiente paso es calcular la iluminaci�n, y lo hace con cuatro mapeados que, para que nos entendamos si no sois muy t�cnicos, son como cuatro capas que calculan diferentes aspectos de la imagen tridimensonal. El primero es el llamado albedo map, que contiene el color de las texturas que cubren los pol�gonos, as� como su opacidad. El segundo, el normal map, a�ade un efecto de relieve a las mallas poligonales, permitiendo que iluminaci�n a�ada mucho m�s detalle y volumen a superficies planas o menos detalladas. El siguiente es el specular map, que indica c�mo refleja la luz ese elemento, incluyendo c�mo la luz penetra superficies como la piel. El �ltimo es el depth map que, como bien recoge su nombre, calcula la profundidad de la imagen.

A�adiendo detalle

Con la base m�s o menos lista, llega el momento de comenzar a a�adir detalle. As�, el Fox Engine comienza a calcular la velocidad de los elementos en pantalla para a�adir el desenfoque de movimiento. Al tratarse de una escena muy est�tica, tan s�lo el personaje en llamas (cuyo nombre no vamos a mencionar, tranquilos) se considera din�mico, en un esfuerzo por optimizar recursos en personajes que no se mueven lo suficientemente r�pido para justificar aplicarles desenfoque de movimiento. Como nota, aqu� s�lo se calcula qu� elementos se van a desenfocar y cu�nto, y el efecto como tal se aplicar� m�s adelante. Lo siguiente es la oclusi�n ambiental, una t�cnica que sombrea las zonas que recibir�an menos luz ambiental, como esquinas, puntos donde convergen varios elementos, zonas estrechas, etc�tera. Es importante destacar que el objetivo de esta t�cnica no es tanto recrear sombras, sino recrear la falta de luz. El motor de Konami combina dos t�cnicas diferentes, sobre las que pod�is descubrir m�s en el art�culo que enlazamos al inicio.

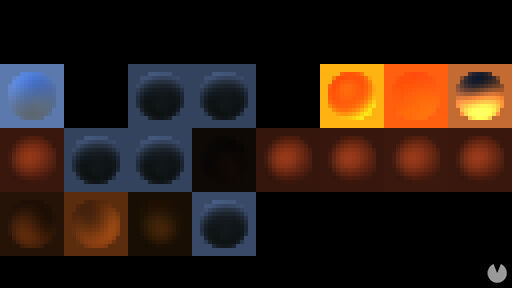

Los ingenieros y artistas de Kojima Productions trabajaron en un interesante sistema para integrar la iluminaci�n global en el juego �la t�cnica que emula c�mo la luz ilumina un escenario tanto de manera directa como indirecta�, consistente en esferas que recogen la iluminaci�n en diferentes partes del escenario. Estas esferas se generan durante el desarrollo para evitar que el motor tenga que hacer los c�lculos en tiempo real, limit�ndose a representar y aplicar los resultados en funci�n de la posici�n del jugador y la informaci�n generada por los mapeados que coment�bamos antes. Como nota, este c�lculo se hace a la mitad de la resoluci�n del juego, y se escala internamente a la resoluci�n nativa.

Con la base de la iluminaci�n lista, toca a�adir m�s luces. Primero, se a�aden las luces din�micas que no proyectan sombra, y su iluminaci�n se calcula, esta vez s�, a resoluci�n completa. Se hacen dos pases, uno que calcula c�mo ilumina y otro que calcula c�mo se refleja la luz en los diferentes elementos a su alrededor. Despu�s de las luces sin sombras, llegan las luces que proyectan sombras. Estas son mucho m�s exigentes, ya que requieren generar un mapeado de sombras para cada luz. El proceso es similar, calculando la iluminaci�n (esta vez incluyendo las sombras que proyectan) y c�mo se reflejan. En este punto se combinan todas las �capas� y se genera la imagen base sobre la que se ajustar� el color y se a�adir�n los efectos.

Los m�ltiples toques finales

Con la imagen base terminada, el Fox Engine comienza a�adir multitud de efectos, empezando por los objetos que emiten luz, como el cartel de salida o las llamas de personaje. A la vez, se dibujan los objetos transparentes. Lo siguiente es a�adir los reflejos. Como en muchos juegos, aqu� encontramos dos tipos. Por una parte tenemos los llamados cubemaps, un cubo que contiene una imagen prerrenderizada (es decir, que no se genera en tiempo real) de nuestra ubicaci�n y que modifica su perspectiva en funci�n de la posici�n de la c�mara. Como nota, en Metal Gear Solid V: The Phantom Pain hay una cantidad enorme de cubemaps, teniendo en cuenta la variedad de localizaciones, que las fases transcurren a diferentes horas del d�a y con diferentes condiciones atmosf�ricas. Luego, se a�aden las screen space reflections, que son los reflejos basados en elementos que vemos en la pantalla. Estos s� son en tiempo real, pero tienen la importante limitaci�n de que, si no est�n fuera de la imagen renderizada, no se pueden mostrar.

La imagen sigue ganando en detalle con la distorsi�n del calor de las llamas de personaje, los decals (texturas que se aplican de manera din�mica, como por ejemplo, agujeros de bala que generamos al disparar), y las part�culas, como el fuego. Despu�s, se genera el bloom, ese brillo/aura que generan ciertas luces en un proceso sorprendentemente complejo que os animamos a ver en el art�culo original. El siguiente paso es la profundidad de campo, que enfoca y desenfoca objetos en funci�n de la c�mara. El motor genera una imagen cercana y una lejana, las modifica en funci�n del enfoque deseado y las combina.

La imagen ya est� casi completa, y ahora es el turno de los efectos de polvo y resplandor en la c�mara, que imitan c�mo la lente reflejar�a la luz en la vida real. Finalmente, se usan los datos del desenfoque de movimiento que se generaron al principio par distorsionar los elementos necesarios. Los desarrolladores tienen la opci�n tambi�n de modificar el color de la imagen para darle un toque m�s personal, ya sea ajustando los blancos, aplicando filtros� y el motor introduce esos cambios en este momento. Con la imagen pr�cticamente terminada se aplica el antialiasing, que suaviza los p�xeles para reducir, en medida de lo posible, los bordes serrados y, por �ltimo, se a�aden unos sprites que permiten iluminar u oscurecer zonas en pantallas. Esto es algo muy caracter�stico en Metal Gear Solid V: The Phantom Pain, y es, sencillamente, una opci�n para que los desarrolladores tengan control total sobre la apariencia del juego.

Este es un ejemplo de un motor en concreto, y el proceso, l�gicamente, varia en funci�n del motor, del juego y de las necesidades de cada desarrollador. Lo que no suele variar es que, una vez terminada la imagen, esta se mandar� a nuestra pantalla y la GPU volver� a repetir todo este proceso desde cero para general el siguiente. 30, 60, o 120 veces por segundo.