La gran promesa más futurista de la inteligencia artificial —esa idea de que una máquina acabará despertando, sintiendo y mirando al ser humano como una especie menor— acaba de recibir un golpe incómodo desde dentro de uno de sus templos. Alexander Lerchner, investigador de Google DeepMind, ha publicado un trabajo en el que sostiene que la IA podrá simular conciencia de forma cada vez más convincente, pero no instanciarla realmente. No habla de una limitación temporal, ni de falta de potencia, ni de que todavía no hayamos llegado al nivel adecuado de escala. Su tesis es mucho más dura: dice que el planteamiento de base está mal.

El paper, titulado The Abstraction Fallacy: Why AI Can Simulate But Not Instantiate Consciousness, plantea que buena parte del debate actual sobre conciencia artificial descansa sobre el llamado computational functionalism, la idea de que la experiencia subjetiva podría emerger simplemente de la organización causal abstracta de un sistema, con independencia del sustrato físico que la soporte. Lerchner rechaza esa premisa y la llama “falacia de la abstracción”: para él, la computación simbólica no es un proceso físico intrínseco del mundo, sino una descripción impuesta por un observador que interpreta ciertos estados como significativos.

La falacia que cuestiona la conciencia artificial

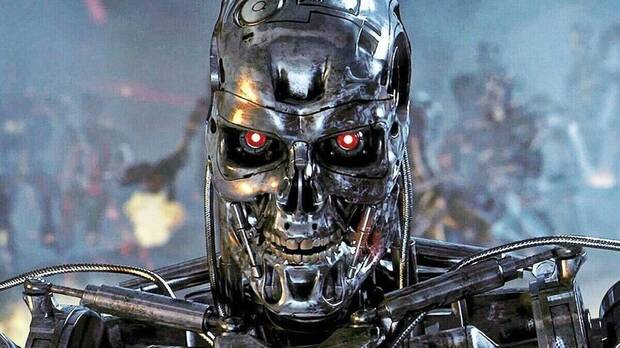

Dicho de forma menos filosófica y más brutal: una IA puede llegar a parecer asustada, ofendida, enamorada o autoconsciente, pero eso no significa que haya una experiencia interna detrás de esa actuación. Según Lerchner, el sistema no “siente” nada; ejecuta una estructura formal que nosotros leemos como si hubiese alguien dentro. Y ahí está el dardo que complica tanto el relato dominante de la industria: si tiene razón, entonces buena parte del discurso que durante ańos ha alimentado el miedo a una IA sentiente tipo HAL 9000 o Skynet no sería una amenaza técnica inminente, sino una mezcla de extrapolación filosófica y marketing futurista muy rentable.

Eso no convierte su postura en una verdad cerrada ni en la “posición de Google”. De hecho, el propio manuscrito incluye una advertencia explícita: las conclusiones representan la investigación y la opinión del autor y no reflejan necesariamente la postura oficial de su empleador. Además, el texto no se ha publicado como gran paper experimental en Nature o Science, sino como un trabajo filosófico-teórico depositado en PhilArchive y difundido también por DeepMind como publicación de investigación. Es decir, no estamos ante una demolición consensuada del sueńo de la conciencia artificial, sino ante una intervención muy fuerte dentro de un debate que sigue abierto.

Un debate que sigue lejos de cerrarse

Y ese matiz importa mucho, porque el campo está lejos de hablar con una sola voz. En los últimos ańos han aparecido marcos teóricos que clasifican precisamente las objeciones a la conciencia en IA y distinguen entre quienes la ven improbable, quienes la creen posible bajo ciertas condiciones y quienes la consideran directamente imposible. Incluso trabajos recientes en arXiv muestran que este sigue siendo un terreno profundamente disputado, más filosófico que experimental en muchos aspectos. Lerchner no cierra la conversación: la radicaliza. Lo que hace es desplazar el foco desde “cuándo llegará la conciencia artificial” hacia “si estamos cometiendo un error categorial al pensar que la computación basta para producirla”.

Por eso el texto resulta tan incómodo. No porque diga que la IA no vaya a transformar el mundo —en eso no entra tanto—, sino porque sugiere que el gran espectáculo narrativo de la industria puede estar apuntando en la dirección equivocada. El peligro, bajo esta lectura, no sería una máquina que despierta por sí sola, sino las empresas y los humanos que la diseńan, la venden y la presentan como algo que quizá no es.